Entrada dedicada a Eddy Ricardo Vélez, quien desde Ecuador me empujó a aricular esta potente idea evaluativa.

Hay una escena en Doce hombres sin piedad en la que pienso cuando escribo estas líneas sobre corregir: un jurado tiene que decidir si un chico es culpable o inocente. Doce tipos encerrados en una sala. Y uno a uno, van emitiendo su veredicto de forma aislada, sin confrontar realmente los argumentos. Hasta que Henry Fonda se levanta y dice: esperad. Comparemos opiniones.

No lo recuerdo exactamente así, claro. Pero la idea se me quedó grabada.

Creo que en la mayoría de casos, eso es exactamente lo que hacemos los docentes cuando evaluamos: encerrarnos en nuestra sala con una pila de trabajos, convencidos de que somos objetivos, y emitir veredictos en solitario que —si somos honestos— no aguantarían un escrutinio serio.

Lo sé porque lo he vivido. Hace bastantes años, corregí 22 redacciones de quinto. Les puse una nota. Las guardé. Las volví a leer tres semanas después —por una reclamación de una familia— y me encontré con que al menos cuatro de ellas habrían recibido una nota diferente si las hubiera corregido de nuevo.

No es que fuera un mal docente. Es que soy humano. Y los humanos, cuando evaluamos en términos absolutos, lo hacemos fatal.

El problema que nadie quiere admitir

Llevamos décadas construyendo sistemas de evaluación como si el problema fuera la falta de estructura. Más criterios. Más descriptores. Rúbricas con cuatro niveles y dieciséis casillas. Escalas de logro tan detalladas que necesitas un máster para interpretarlas. Y con todo eso, seguimos sin resolver el problema de fondo. Porque el problema no es estructural. Es cognitivo.

Cuando un docente lee un texto y decide si merece un 6, un 7 o un 8, esa cifra no existe en ningún sitio de la realidad. Se la está inventando sobre la marcha. El número es una construcción mental que varía según el día, el cansancio, el trabajo anterior que ha corregido, el tiempo que hace, si ha desayunado bien o si lleva tres horas en reunión de claustro. Esto no es una intuición mía. Es lo que lleva décadas mostrando la investigación en psicometría: ya en los años veinte, el psicólogo Louis Leon Thurstone demostró que los juicios absolutos son mucho menos fiables que los juicios comparativos. Más recientemente, investigadores como Daisy Christodoulou y Alastair Pollitt han documentado con rigor cómo la evaluación directa —poner una nota a un trabajo de forma aislada— sufre de una inconsistencia sistemática que las rúbricas no corrigen, sino que a veces solo disimulan. Disimulan: esa es la palabra exacta.

La pregunta que lo cambia todo

Cambiemos la pregunta. En lugar de preguntarte «¿este texto es un 7 o un 8?», pregúntate esto: «¿cuál de estos dos textos es mejor?» Algo cambia inmediatamente. Dudas menos. Decides más rápido. Y —aquí viene la parte que más nos interesa— eres más consistente.

¿Por qué?

Porque comparar es una habilidad cognitiva mucho más robusta que asignar valores absolutos. Nuestro cerebro lleva miles de años comparando cosas para sobrevivir. Decidir si una fruta está más madura que otra, si un camino es más peligroso que el de al lado, si este individuo es más fiable que aquel. La comparación es evolutivamente antigua. El «7 sobre 10» es una convención cultural que llevamos usando, como mucho, un siglo. A eso se le llama juicio comparativo. Y tiene más fundamento científico del que parece.

En qué consiste exactamente

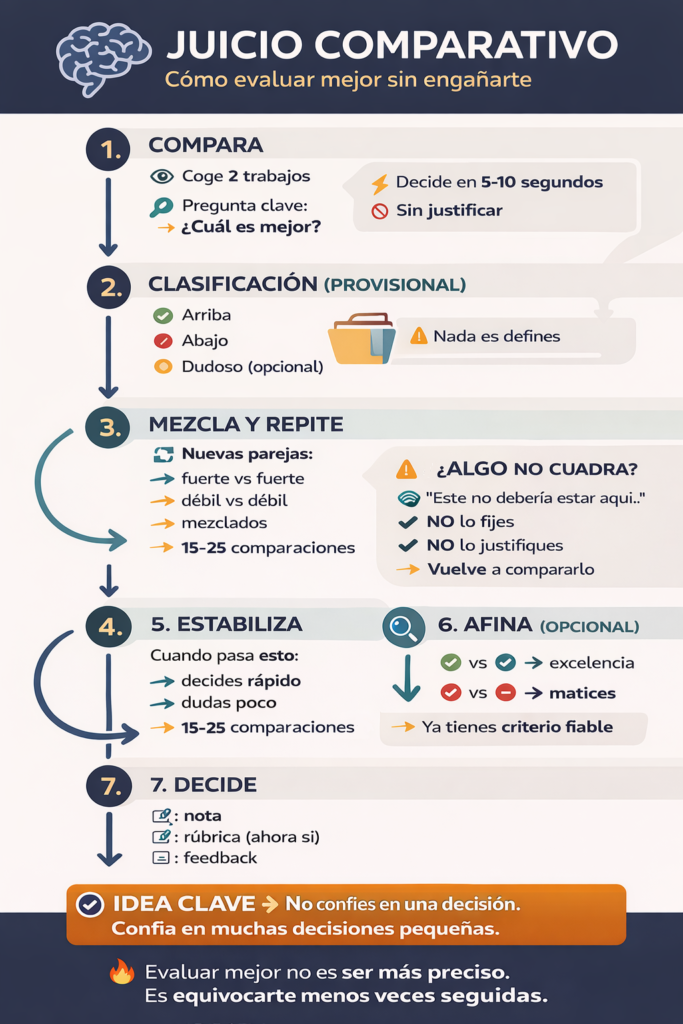

El método es simple hasta resultar casi ridículo: coge dos trabajos. Decide cuál es mejor. Sin justificar. Sin pararte demasiado a pensar. Solo: ¿cuál es mejor?

Luego repite con otro par. Y otro. Y otro.

A partir de unas quince o veinte comparaciones, empieza a emerger algo valioso: un ranking coherente. No perfecto, no infalible, pero mucho más fiable que el que construirías corrigiendo trabajo por trabajo con una rúbrica.

En su versión más sofisticada —la que usan en investigación y en sistemas de evaluación externos— las decisiones de múltiples evaluadores se combinan usando modelos estadísticos como el de Bradley-Terry, que agregan los juicios comparativos para construir una escala de calidad robusta. Pero no necesitas saber estadística para beneficiarte de la idea. Lo que necesitas es entender por qué funciona.

Por qué esto nos incomoda (y por qué tiene sentido que nos incomode)

El juicio comparativo pone en cuestión algo en lo que hemos invertido mucho: la ilusión de que evaluar bien es evaluar con precisión milimétrica. Las rúbricas nos dan sensación de objetividad. Están escritas. Son públicas. Las podemos mostrar a las familias, tienen niveles y parecen justas. Pero dos docentes pueden usar la misma rúbrica con los mismos trabajos y llegar a notas muy distintas. Lo hemos visto todos. Lo hemos vivido todos. Y en vez de cuestionar el sistema, normalmente concluimos que «hay que ponerse de acuerdo en los criterios» y añadimos más descriptores. Y más descriptores = Más falsa precisión.

Lo que el juicio comparativo propone es algo más honesto: aceptar que no somos máquinas de puntuar, y usar ese reconocimiento a nuestro favor. Porque hay otra cosa que nadie dice en voz alta: cuando corregimos 25 redacciones, ya usamos juicio comparativo. Mentalmente. Sin control. De forma caótica. «Esta está por encima de la media.» «Esta es mejor que las tres anteriores.» «Esta es, con diferencia, la más floja.» Lo hacemos. Lo hacemos siempre. La diferencia es que lo hacemos sin reconocerlo, sin aprovechar su potencial, y mezclado con todo el ruido de la corrección lineal.

Dónde funciona (y dónde no)

Seré directo, porque en educación hay una tendencia peligrosa a convertir cualquier idea interesante en la solución universal a todos los problemas: el juicio comparativo funciona especialmente bien con tareas abiertas y complejas: redacciones, ensayos, proyectos, trabajos creativos, respuestas de desarrollo. Precisamente ahí donde la calidad es difícil de capturar con criterios rígidos, donde «se nota» que algo está mejor pero cuesta decir exactamente por qué.

No es la mejor herramienta para evaluar si alguien sabe multiplicar fracciones o conoce las capitales de Europa. Para eso, otros métodos funcionan mejor y más rápido. La pregunta que debes hacerte antes de aplicarlo es: ¿esta tarea tiene múltiples formas válidas de hacerse bien? Si la respuesta es sí, el juicio comparativo tiene algo que ofrecerte.

Cómo usarlo mañana (sin complicarte la vida)

Pongamos que tienes 20 redacciones de sexto. No coges la rúbrica. No empiezas por la primera y vas hasta la última. Haces esto:

Coges dos al azar. Decides cuál es mejor. Las cinco o diez segundos que tardas en llegar a esa decisión son suficientes. No la justifiques todavía. Coge otras dos. Repite.

Después de quince o veinte comparaciones, tendrás algo que quizás no esperabas: una idea bastante clara de qué trabajos están arriba, cuáles están en la zona media y cuáles necesitan mejorar.

A partir de ahí, si necesitas nota, puedes asignarla. Si quieres más precisión en los extremos, haz una segunda ronda comparando solo dentro de los grupos. Y si quieres afinar todavía más, compara los mejores entre sí para identificar los sobresalientes reales. Si en algún momento sientes que un trabajo ha acabado en el grupo equivocado —y pasará, es normal— no lo fijes donde está. Vuelve a compararlo con otros. El sistema se autocorrige. Un juicio puede fallar. El conjunto de juicios tiende a acertar.

La idea que me gustaría que te llevaras

No te estoy diciendo que abandones las rúbricas. Te estoy diciendo que dejes de tratarlas como si fueran objetivas cuando no lo son. Hay una diferencia enorme entre usar una rúbrica como herramienta de comunicación —para que el alumno entienda qué se valora— y usarla como si fuera una báscula de precisión que te da el peso exacto de cada trabajo. No lo es. Nunca lo ha sido.

El juicio comparativo no es perfecto. Tiene sus propias limitaciones, requiere un cierto volumen de trabajo para funcionar bien, y su versión más sofisticada necesita herramientas digitales que aún no están integradas en la mayoría de las aulas. Pero tiene algo que pocas propuestas de evaluación tienen: es honesto con nuestras limitaciones cognitivas. No pretende convertirte en una máquina. Aprovecha que eres humano —con todo lo que eso implica— y lo usa a tu favor.

Nota final para los más viejunos de estos lares: Busque, compare y si encuentra algo mejor…¡cómprelo!

Bibliografía

- Thurstone, L. L. (1927). A law of comparative judgment. Psychological Review, 34(4), 273–286.

- Pollitt, A. (2012). The method of adaptive comparative judgement. Assessment in Education: Principles, Policy & Practice, 19(3), 281–300.

- Christodoulou, D. (2016). Making Good Progress? The Future of Assessment for Learning. Oxford University Press.

- Laming, D. (2004). Human Judgment: The Eye of the Beholder. Thomson Learning.

- Bramley, T. (2007). Paired comparison methods. En P. Newton, J. Baird, H. Goldstein, H. Patrick & P. Tymms (Eds.), Techniques for Monitoring the Comparability of Examination Standards (pp. 246–294). Qualifications and Curriculum Authority.

- Van Daal, T., Lesterhuis, M., Coertjens, L., Donche, V., & De Maeyer, S. (2019). Validity of comparative judgement to assess academic writing: Examining implications of its holistic character and building on a shared consensus. Assessment in Education: Principles, Policy & Practice, 26(1), 59–76.

Si este artículo te ha generado alguna de esas incomodidades útiles, las que te hacen replantearte algo sin que nadie te obligue, ya ha hecho su trabajo. Si encima lo aplicas en clase la semana que viene, ya seremos dos.